4.1 Preview

| 一家公司的成員們想藉由multicast傳達聲音的方式,進行 |

| 一場線上會議。會議的主席透過某種配置的機制,獲得了一個 |

| multicast address,以及一對port,其中一個port是為了RTP(傳 |

| 送聲音),另一個則是為了RTCP(傳送控制packet)。這些位置與 |

| port的資訊會分布給所有想加入會議的公司成員。 |

| 使用聲音會議程式的公司成員,可送出一小塊的聲音資料 |

| ,每一小塊資料前會被加上RTP的header。RTP header會指出 |

| 每一個packet所包含的資料是用什麼壓縮方式,像是PCM, |

| ADPCM, LPC…等。在會議的過程之中,傳送聲音資料的公司成 |

| 員,可以改變聲音的壓縮方式,以配合經由窄頻連接到 |

| Internet的的新加入者,或是對網路壅塞做出反應。 |

| 如同其它packet網路一般,Internet偶而也會遺失 一來, |

| packet,或是將packet的順序用亂。為了處理這些損害,RTP |

| header會包含時間的資訊,以及一個sequence number。如此 |

| 所有加入會議的成員就可以依此來重組收到的packet,甚至估 |

| 計有多少packet遺失。 |

| 因為在會議的過程之中,公司成員們可能會加入或離開會 |

| 議,所以知道某人在何時加入,還有他接收資料的狀況,會是 |

| 很有用的。為了達到這個目的,每一個會議上的application,都 |

| 會在RTCP的port上,定期群播包含使用者名稱的reception |

| report。Reception report會指出傳送聲音資料的成員,被接收 |

| 的程度如何,也可以用來控制適合的聲音壓縮方式。當然,除 |

| 了使用者名稱,其它辨識資訊可視控制頻寬的限制,被加入 |

| reception report。當某人想離開此一會議,application將送出 |

| RTP BYE packet。 |

4.2 RTP

| 即使在壅塞的線路上,TCP還是可以保證資料的正確性; |

| 但是對於即時性的封包和多址傳遞,TCP就無能為力,因此,就 |

| 有了RTP這個東西。 |

| RTP (Real-Time Transport Protocol, 即時傳輸協定) 在, |

| IETF RFC 1889中定義,而透過RTP載送語音和影像資料的方法 |

| 則在RFC 1980,這兩項標準早在1996年一月就提出,不過在 |

| 1997年底才定案。 |

| RTP是在網路層 (Network Layer) 和傳輸層 (Transport 用 |

| Layer) 中,因此除了TCP以外,RTP還可以在ATM、IPX環境使 |

| ;事實上,雖然RTP設計的時候是和TCP一起運作,但大多數的 |

| 實作中,RTP並不是和TCP一起運作,而是和UDP。 |

| 在RTP的標題中,提供了必要的時間資訊 (timing |

| information),如此接收端才知道傳輸的過程中,是否有封包遺 |

| 失了,以及接收到封包之順序,此外,RTP標題還包含了資料的 |

| 形式判別,如此允許各種資料和各種壓縮格式,均經由RTP資料 |

| 傳遞。 |

4.2.1 RTP專有名詞介紹

| RTP packet: 一個開頭有RTP header的packet,即為RTP 可以包 |

| packet。通常在底層protocol中,一個packet只包含一個RTP |

| packet,但透過一些特別的encapsulation方法,底層packet也 |

| 含一個以上的RTP packet。 |

| RTP payload: 在RTP packet中,真正要傳送的資料,即為RTP |

| payload。例如在影像會議中,影像資料就是RTP payload。 |

| RTCP packet: 一個開頭是RTCP header,後面接著控制資料的 |

| packet,即為RTCP packet。通常許多RTCP packet會被結合, |

| 再加上底層的header,而結合後的RTCP packet長度會被紀錄在 |

| RTCP header中的length欄位。 |

| Port: 當RTP想傳送RTP packet與RTCP packet到同一個IP |

| Address時,port就可以用來區分目的地的不同。 |

| Transport address: 一般都是IP Address加上UDP port。 |

| packet都是從一個source transport address傳到一個destination |

| transport address。 |

| RTP session: 對於每一個RTP使用者而言,RTP session是由一對 |

| destination transport address定義而成(一個為了RTP,另一個 |

| 為了RTCP)。要注意的是,一個多媒體會議中,不同的媒體資料 |

| 最好在不同的RTP session中傳送。 |

| Synchronization source (SSRC): SSRC是一個隨機選取的識別值 |

| ,用意是使一個RTP session中的participant都有獨一無二的識 |

| 別資訊。但是同一個使用者在不同的RTP session中,並不一定 |

| 要用同一個SSRC。 |

| Contributing source (CSRC): 之前提過mixer可以將不同來源的 |

| RTP packet混和放到同一個RTP packet中。此時,RTP也會在 |

| RTP header中紀錄與這個packet有關的SSRC,而這些SSRC合起 |

| 來就叫做CSRC。 |

| End system: 如果一個application可以產生內容被包在RTP 被稱 |

| packet中被傳送,或是可以讀取RTP packet中的內容,就可以 |

| 為End system。 |

| Monitor: 如果一個application可以接收在一個RTP session中所 |

| 有participant送來的RTCP packet,就可以被稱為Monitor。 |

| Monitor可以被內建在End system中﹔也可以不直接參與RTP |

| session,這種Monitor被稱為Third Party Monitor。 |

4.2.2 RTP Header

4.2.2.1RTP Header中的固定欄位

|

0 |

1 |

2 |

3 |

||||||||||||||||||||||||||||

|

0 |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

0 |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

0 |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

0 |

1 |

|

V=2 |

P |

X |

CC |

M |

PT |

Sequence

number |

|

Timestamp |

||||||

|

Synchronization source (SSRC) identifier |

||||||

|

Contributing

source (CSRC) identifier …… |

||||||

|

4.2.2.2RTP Header欄位說明

|

| Version (V): 說明RTP的版本。 |

| Padding (P): 如果這個欄位被設定,RTP packet尾端將會包含 |

| 一個以上的padding octets,但它們並不是RTP payload的一部 |

| 份,而在padding的最後一個octet會記錄在這個RTP packet中有 |

| 多少個octet。在某些壓縮演算法,或是底層的通訊協定, |

| padding有可能會被用到。 |

| Extension (X): 如果這個欄位被設定,在固定的RTP header後還 |

| 要加上一個 header extension。 |

| CSRC count (CC): 紀錄CSRC的個數。 |

| Marker (M): 用作重要事件,像是影像中frame的界限識別值。 |

| 這個值的解釋是留給application去處理。 |

| Payload type (PT): 用來定義RTP payload的format,而format的 |

| 解釋則是留給application去處理。 |

| Sequence number: 每送出一個RTP packet之後,sequence 偵 |

| number就會增加一。Sequence number也可以被receiver用來 |

| 測packet loss,以及恢復packet的順序。 |

| Timestamp: 記錄RTP packet第一個octet被讀取的取樣時間。 |

| SSRC: 如同前面的定義。要注意的是,如果一個source改變它 |

| 的source transport address,它必須選擇一個新的SSRC。 |

| CSRC list: 如同前面的定義。要注意的是,如果一個RTP |

| packet包含15個以上的CSRC,只有15個CSRC可以被識別。 |

4.2.3 RTP Payload format for MPEG4 Visual Streams

|

在RFC(Request for Comments)3016中,提到RTP的 |

|||||||

| Payload format for MPEG4 Audio/Visual Streams,其中討論到 | |||||||

| 該如何對MPEG4的visual bitstream做切割來防止一些突發狀況 | |||||||

| ,例如RTP封包遺失後,造成的影像無法decode的問題等等。 | |||||||

| 底下為其提供的幾個切割的範例: | |||||||

| (a) | |||||||

|

|||||||

| (b) | |||||||

|

|||||||

| (c) | |||||||

|

|||||||

| (d) | |||||||

|

|||||||

| (e) | |||||||

|

|||||||

| (f) | |||||||

|

|||||||

| 其中以(c)適合於Packet-Loss rate較高的網路,我選擇使用這 | |||||||

| 個方式在Wireless LAN上應用。 |

4.3 RTCP

4.3.1 RTCP簡介

| RTCP的原理就是,使用與RTP傳送packet一樣的傳送機制,每 |

| 隔一段時間就傳送control packet。 |

4.3.2 RTCP三大功能

| (1)RTCP主要的功能是了解資料distribution的quality。再配合 |

| distribution機制,像是IP Multicast,就可以讓network service |

| provider這類實際上沒有加入RTP session的單位,去診斷網路上 |

| 的問題。 |

| (2)RTCP包含一個不變的RTP source的transport-level CNAME來 |

| identifier,叫做canonical name或是CNAME。Receiver依靠 |

| 追蹤每一個participant。RTP也使用CNAME在一組相關的RTP |

| sessions中,將來自同一個participant的多的data stream作聯繫 |

| 。 |

| (3)前面兩個功能都需要所有的participant傳送RTCP packet,所 |

| 以為適應大量的participant,傳送的速率就要控制。透過每一個 |

| participant傳送RTCP packet給其他participant,所有的 |

| participant可以觀察現在participant總數目,而這個數目就用來 |

| 計算傳送RTCP packet的速率。 |

4.3.3 RTCP Packet種類

| RTCP packet可以包含以下五種資訊: |

| SR: 紀錄sender的reception statistics。 |

| RR: 紀錄receiver的reception statistics。 |

| SDES: 有關source的資訊,像是CNAME。 |

| BYE: 指出某一participant的離開。 |

| APP: 指出某一application特有的functions。 |

4.3.4 RTCP 注意事項

| (1)每一個RTCP packet最前面都會有固定的部分,然後根據倍 |

| packet種類的不同,接著長度不同的資料,但總bit數都是32的 |

| 數。 |

| (2)多個RTCP packet可以結合,而不需要任何的separator。 |

| (3)每一個RTCP packet一定要包含SR/RR與有CNAME的SDES, |

| 而且SR/RR一定是在最前面。 |

5.Implementation

5.1 整體架構

| 整個project是實作Linux PDA平台的streaming,負責接 |

| 收另外一組Windows平台Streaming所送出的video/audio |

| streams,並送給decoder並做display。 |

5.1.1 Framework

5.1.2 Server

| Server端採用Windows平台的Server,將已經壓縮好的 |

| 影像及聲音,以Multicast的方式傳送。也可以透過Server上安裝 |

| CCD擷取壓縮影像並傳送至網路上 |

5.1.3 Client

| Client端加入Multicast群組後,便可開始接收Server端 |

| 的資料,不論Server端送出的是Video Clip或者是CCD擷取的影 |

| 像,皆可順利接收。 |

5.2 RTP實作

5.2.1 RTP Sender

| RTP Sender是採用另外一組專題同學所設計的Sender, |

| 而這邊有經過修改,RTP Payload中都是frame based的video和 |

| audio的data,由於尚無法實作4.2.3中所談到的切割方式,所以 |

| 先利用這樣的方式,還是可以達到所預期的效果-封包掉了以後 |

| Receiver端仍然可以正常播放。 |

5.2.2 RTP Receiver

| RTP Receiver端,先判別是否收到Header,收到Header |

| 後,便開始接收接下來的封包,否則的話都先drop。收到封包 |

| 後,先將data送到cache layer做一段buffer,再送給decoder, |

| 最後再做輸出。 |

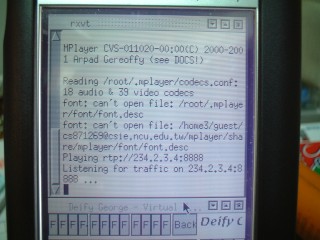

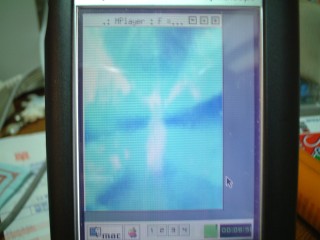

5.3 Screenshots

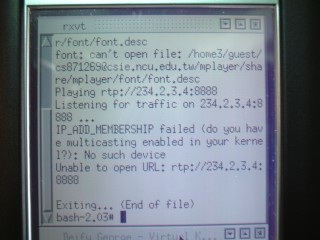

|

|

| Screenshot 1 | Screenshot 2 |

|

|

| Screenshot 3 | Screenshot 4 |

6.ToDo

| ☉加強MP3 Decoder在decode mp3 stream的能力。 |

| ☉加強RTP和RTCP功能 |

| 在RTP和RTCP有許多機制可以讓我們去作反應和調整,若能好 |

| 好研究,就能善用現有的功能。 |

Appendix參考資料

☉RFC 3016 - RTP Payload Format for MPEG-4 Audio/Visual Streams

☉RTP Official Site (http://www.cs.columbia.edu/~hgs/rtp/)

☉FFMpeg (http://ffmpeg.sourceforge.net)

☉MAD: MPEG Audio Decoder (http://www.mars.org/home/rob/proj/mpeg/)

☉Online MSDN (http://msdn.microsoft.com)

☉AVI RIFF FORMAT(http://www.oreilly.com/centers/gff/formats/micriff/index.htm)

☉MPlayer (http://www.mplayerhq.hu/homepage/)

☉RTP Library in dvbstream(http://www.linuxtv.org/news/martin/dvbstream03.xml)

☉DearHoney (http://www.dearhoney.idv.tw)